Meta AI的SAM模型是一种图像生成和图像理解的混合模型

SAM模型基于Transformer架构,使用了超过100亿个参数,是迄今为止最大的视觉模型之一。它的训练使用了大量的图像数据集和文本数据集,使得SAM能够对图像进行深入的理解和生成。因此,该模型具有强大的图像生成能力,能够根据不同的关键词或文字描述生成不同的图像,为创意设计、艺术创作等领域提供广泛的应用前景。

SAM模型的功能主要包括:

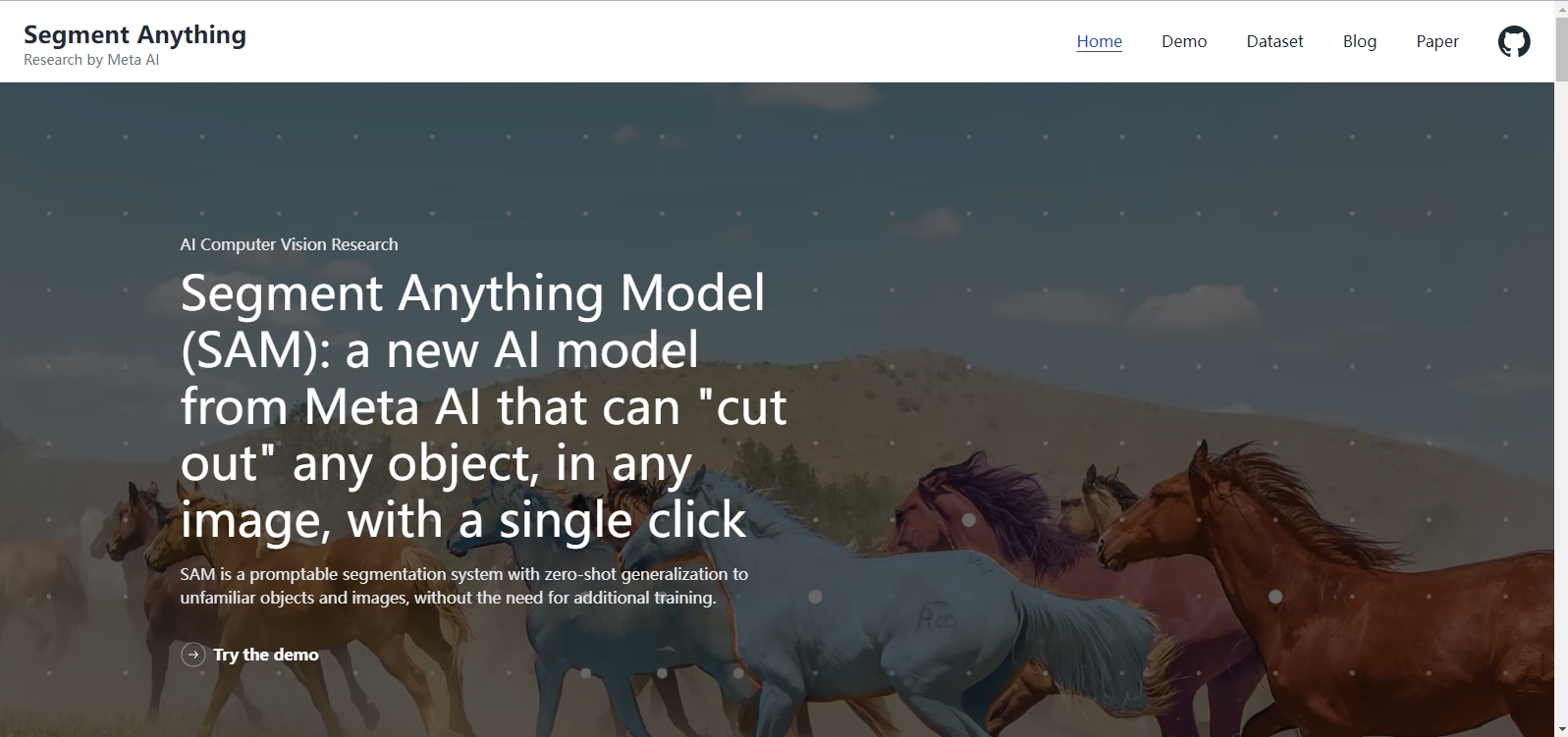

图像分割:SAM可以根据文本指令等方式实现图像分割,识别并分割出图像中的各种物体。

零样本泛化:SAM已经了解了物体是什么的一般概念,这种理解可以在不需要额外训练的情况下对不熟悉的物体和图像进行零样本泛化。

交互操作:用户可以通过将鼠标悬浮在物体之上或输入文字查询等方式,与SAM进行交互,实现物体的识别和分离。