2023-08-08 10:36

2023-08-08 10:36

AIGC竟然能实现电影特效内容创作!分享网友借助AI工作流制作《流浪地球3》预告片

创作者:@数字生命卡兹克

AI绘画工具:Midjourney+Runway组成工作流

工具介绍:

Midjourney一个领先的AI绘画图像生成器工具。通过创造新的人机交互方式,让人们能够更自由、更深入、更有趣地表达自己的想法和创意。利用了最先进的深度学习技术,让用户可以通过简单的文字提示,生成各种类型和风格的图像,从而实现视觉想象的无限可能;

Runway是一个基于人工智能的内容创作工具,使用它可以生成各种类型的艺术作品,包括图像、音乐、文本和视频等。它使用最先进的深度学习技术和算法,使得用户可以通过简单的交互式界面定制和控制模型,生成独特的创意作品。为了生成视频,你需要在Runway中选择相应的模型。一些模型可以生成静态图像,但有些模型可以生成动态的视频。

工具链接:

Midjourney https://www.aieva.cn/sites/404.html

Runway https://www.aieva.cn/sites/251.html

很久以前,就想做一段自己的AI视频。直到前段时间的《芭比×海默》,给了我很大的启发。Midjourney+Runway Gen2的工作流程,终于可以实现我的想法了。于是,我花了5个晚上,用Midjourney生成了693张图,用Gen2生成了185个镜头,最后选出来了60个镜头,剪辑成了我最喜欢的。

《流浪地球3》的预告片,点击下方视频直接播放——

工作流程其实很简单:Midjourney生图,Runway Gen2生成4秒的视频。以下是我用Midjourney生成的部分视觉分镜图。

这些图片,为了分镜风格一致,所以我固定好了后缀提示词。这块部分词组有借鉴国外大神制作的《起源》。

____ , not central composition, Science fiction movie: The Wandering Earth, in the style of detailed crowd scenes, hard sci-fi style, futuristic incredible scene, very imaginative, indoor scenes, movie scene, dynamic shot, low saturation, light white and teal,extreme detail, 8K --ar 21:9 --v 5.2

在前缀空白处描写场景或人物或镜头,后缀一致,这样可以保证画面风格的统一。然后扔到Runway Gen2里生成视频反而是最简单的一步。

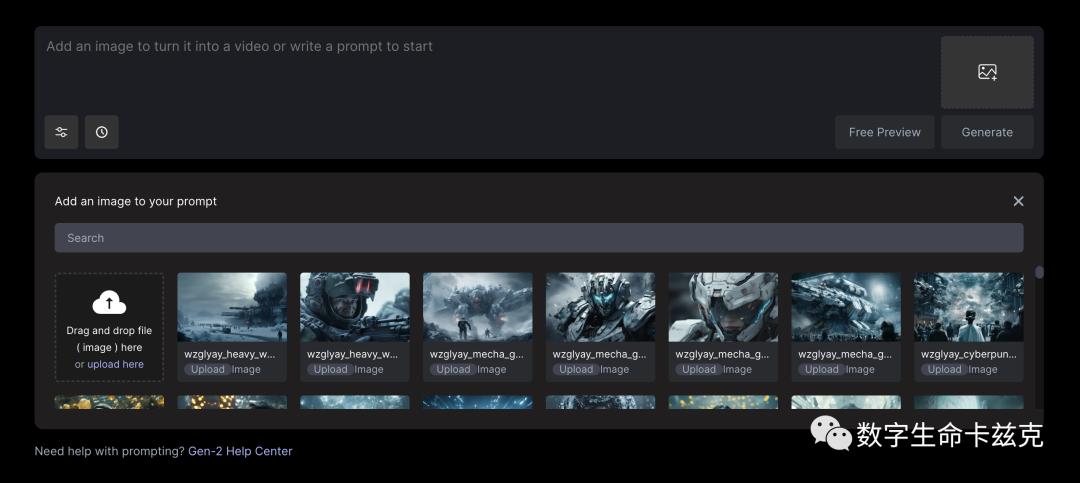

直接把图片上传,生成。不要写任何提示词,只要写任何一句话,基本都会面目全非。说实话Runway Gen2现在的稳定性还是一般,roll了180多个镜头,4秒全能用的一共只有2个。其他的基本都只能用前1~2秒。

但是对于剪辑至少是够了。而且我也遇到了跟《创世纪》作者同样的问题。用Runway Gen2生成人脸视频的时候,一定不要开增强Upscale,要不然面部会变动巨大。生成场景的时候,开增强Upscale效果会更好。

剩下的也没啥技术含量了,roll就行了,最后挑选镜头,按心中的故事或主题剪辑。话说本来我是自己手绘了50个左右的分镜线稿,还写好了故事线,埋了彩蛋,结果发现AI根本不会按我的预期效果去弄。

最后管他呢,量大管饱,生成几百个镜头,总能拼的。这次《流浪地球3》预告片的工作流,对我来说是个很有意思的实验。以前自己做视频,Blender建模渲染,1个多月的时间,现在下班后的5个晚上就搞定。

AI,真的是效率革命。希望本文对你的工作方式有所启发!以上,感谢大家的阅读~希望对大家有所帮助。