2023-06-13 15:35

2023-06-13 15:35

WWDC2023后记丨地表市值第一的苹果公司,为什么「没赶上」AIGC的风口

AI奇点网6月13日报道丨最近科技圈发生了一件令人很“困惑”的怪事,莫过于全球科技巨头苹果公司,竟然对夯爆的AI人工智能“不闻不问”。

就在不久前落幕的苹果WWDC 2023开发者大会上,该公司发布了一款震撼业界的MR头显,企图重新定义VR/AR空间运算。但就是这么一款看似与“人工智能”和“AI算法”强关联的超级终端,整场发布活动的Keynote演讲稿里却只字未提及“AI”,也未提起“ChatGPT”或者“LLM(大语言模型)”等等目前圈内最夯的关键热词。

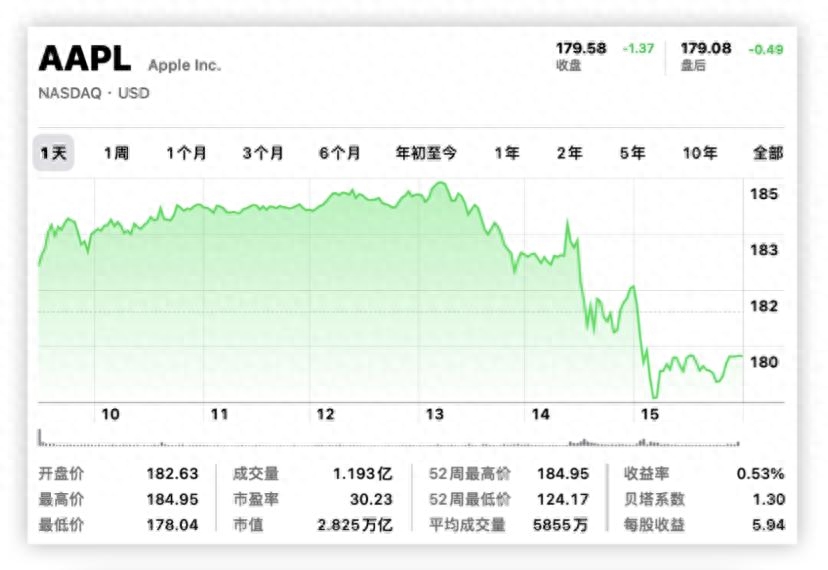

这让不少证券分析师大跌“雪镜”,而紧随发布会一起落幕的还有坠落的AAPL(苹果公司股票代码)股价,非常不给库克面子。很显然,缺乏“AI”这个关键词的AAPL,很难跻身“AI概念股”的成分股。作为对比,当今人工智能算力的龙头企业英伟达,乘上“AI春风”后的股价已经从半年前的低点108美元/股飙涨至最近的高位419美元/股,并成为了全球第七家万亿美元市值企业。

为了沾上AI的“仙气”,刚刚过去的2023年第一财季,标普500指数的五百家头部企业的财报业绩报告会上,有多达110家公司的高管提及“人工智能”关键词。据外媒不完全统计,“人工智能”这个词至少被提及了900次,真是能给人听疯了。

其中,英伟达的分析师会议上提及“人工智能”多达86次,而另外两家人工智能科技巨头谷歌母公司Alphabet的会议上提及的52次,微软也提及了35次。

无论从产品宣传层面,还是营销炒作角度看,苹果公司都是那么“一反常态”。人们不禁要问:苹果是怎么了?

苹果并非没有“追逐”AI,只是单纯“不喜欢”这俩字母

事实上,苹果公司并没有“两耳不闻窗外事,一心只读圣贤书”地闭门造车,相反的,CEO库克非常积极地加入了ChatGPT的体验大军当中。

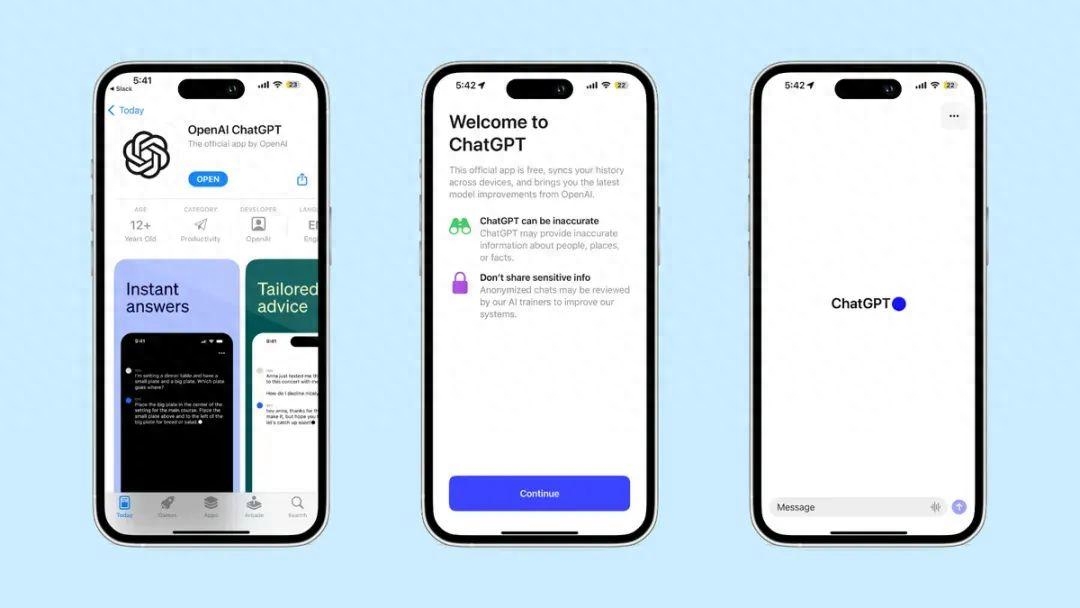

库克在WWDC活动后接受了一家外媒的专访,他透露了对人工智能聊天机器人ChatGPT的“独特体验”感到很兴奋,他已经在办公室“试用”过这款产品。并且很开心见到OpenAI公司已经将ChatGPT的带进iOS应用生态。这家顶尖的人工智能研究公司近期刚刚在苹果App Store应用商店上架了旗下首款ChatGPT应用。

有趣的是,就在今年WWDC大会召开之前,国内外不少媒体都在猜测:“AI”这个词会被苹果公司提及几次?然而最终是一次都没有。

相比于“AI”,苹果官方似乎更喜欢使用“机器学习(Machine Learning)”这个词汇,这让不少吃瓜群众感到一丝丝意外。在整个Keynote演讲里,有好事者进行过统计,苹果公司总共提及了七次“Machine Learning”。

该公司最近推出的MR头显设备Vision Pro,不仅是一台基于虚拟现实增强技术的超级算力终端,该设备也融入了非常多的成熟AI技术,包括调用大量传感器的空间实时动态测算、3D智能建模生成、跟随使用场景和用户习惯调节的各项功能算法等等。

在介绍这款“七年磨一剑”的头显如何给用户实时呈现不可思议的虚拟现实交互画面时,苹果公司更喜欢将其表述为“使用了先进的编码-解码神经网络”算法。诚然,无论是“神经网络”还是“机器学习”,都是当下人工智能领域最基础的理论方法和训练手段。

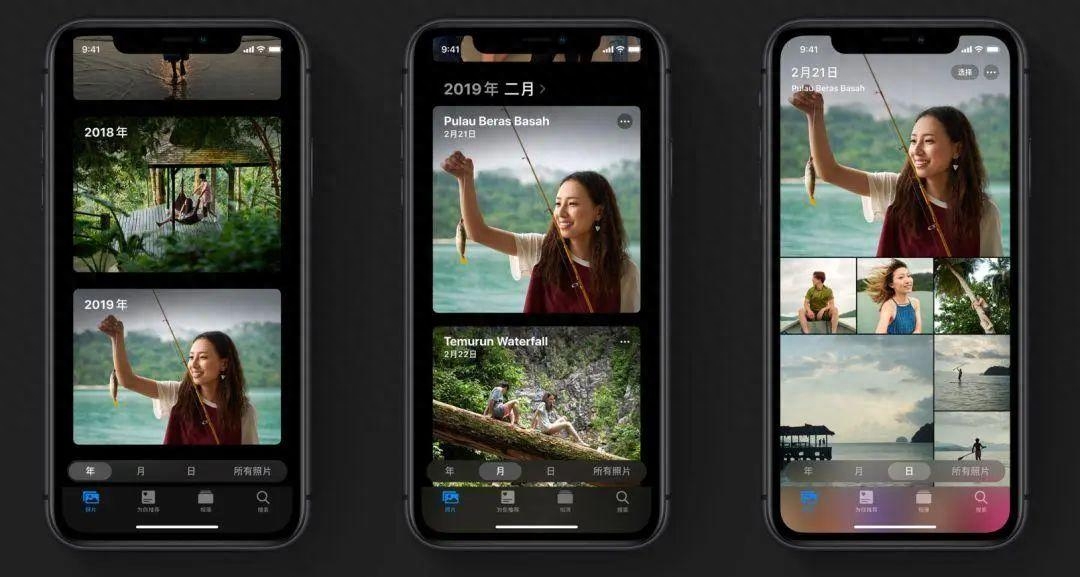

此外,苹果公司现役的大量产品都有融入各色各样的AI应用体验。比如:我们用得最多的iPhone手机相册,iOS系统会根据相册里边平常我们拍摄的图片内容,自动生成对应内容属性的专辑而无需人为管理,甚至会自动根据照片的风格,一键生成视频,并配上符合视频的BGM配乐。你瞧瞧,这不就是近期百度文心一言发布会上喊得最响亮的“AI一键成片”功能么?

总之,苹果官方似乎并不喜欢将这种能力称之为“AI人工智能”。这里边有几大原因:

首先,苹果很少追逐市场新概念,这家公司更喜欢“我行我素”,而不是用与他人相似的花哨文字噱头来包装自己;

其次,“人工智能”这个名词具有较强的宽泛性,很容易被联想为“具有超人类能力的硅基生命新形态”,而目前苹果产品能提供的用户体验却远未触及这一层。事实上,AIGC与真正意义的AI或者AGI也完全不是一回事;

最后,目前人工智能领域面临诸多尚待完善的法律法规缺陷,AI监管的滞后性仍需要国际社会一道提出共同价值的“安全护栏”。从苹果法务部的角度来看,防范将来可能出现的司法纠纷,“AI”一词显然不够“安全”。

在EVA个人来看,目前的AIGC人工智能生成技术,距离真正意义上的AGI(通用人工智能)确实存在较远的距离,毫不夸张地说,AIGC距离AGI中间还隔着10个AIGC。苹果公司倾向于使用“机器学习”一词取代“人工智能”,既符合技术底层逻辑,也符合商业风险管控的需求。

你手上的这台iPhone,早已荟萃大量人工智能技术

库克在WWDC大会后的采访中介绍,虽然苹果已经将AI技术集成到其产品当中,但是一般大众用户可能不容易察觉,这些功能的确是基于人工智能技术开发的,但人们甚至不认为这是“人工智能”范畴。

比如:MR头显就采用了由AI技术自动生成的3D建模人像,来作为使用MR头显与他人进行FaceTime线上通话时,用户自己的第一人称形象。虽然有不少媒体在试戴MR之后表示,生成的“3D自己”多少有点“恐怖谷”效应,但对比扎克伯格领导的Meta团队开发的“元宇宙”世界里边自家老板形象,就显得没那么抽象了……

与微软、谷歌等一众科技大厂在当前大语言模型浪潮中的高调做法截然不同,苹果没有公布自己的大语言模型细节,更没有基于大模型推出一系列落地应用。

尽管苹果没有在今年的WWDC上高谈阔论地聊起大模型,但他们介绍了一些基于AI改进的iOS交互新体验。

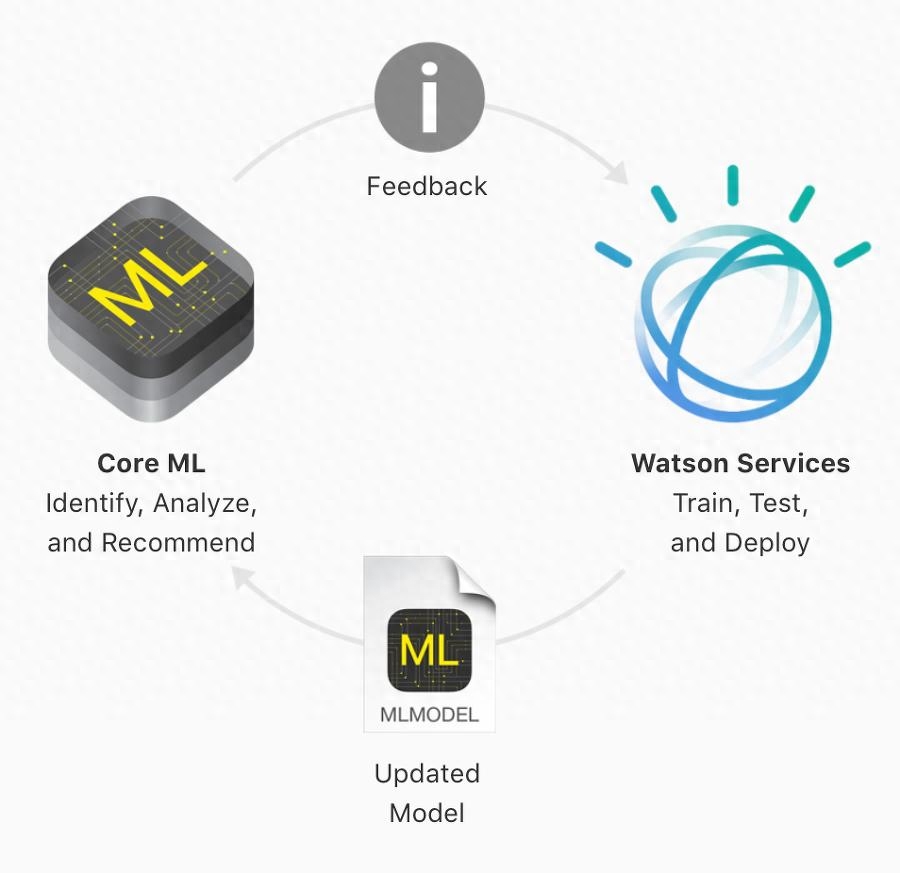

比如:改进的iPhone语法自动纠正能力(Autocorrect),当用户按下空格键时,它可以自动补完整个单词或纠正整个句子的语法错误。该功能基于使用Transformer语言模型的苹果Core ML框架开发,Core ML是该公司在WWDC 2017推出的机器学习和统计模型开发框架。今年的更新,使得iPhone输入法的自动纠正能力变得更为精准,而Transformer正是ChatGPT最重要的底层技术原理之一。

苹果希望iOS系统能够通过机器学习不断改进算法,学习用户发短信与打字的习惯,从而变得更好更人性化。

此外,苹果公司还为iOS 17的辅助功能(通常是针对残疾人)引入一项名为“个人声音”(Personal Voice)的文本转语音的AI新体验。这项功能针对那些失语症人群,通过AI模拟创建一个类似于自己声线的“声音副本”,允许用户在FaceTime、电话以及其他通讯APP中通过输入文字转换为自己的“声音”发送给对方。对于一般大众也可以用于环境嘈杂的地方发送自己的语音。

更早一些时候,苹果公司在迭代版本里边为iPhone的电池保护设置加入了机器学习能力,iOS系统会根据用户使用手机的强度以及用户充电的习惯,进行充电功率变频调配,以减缓iPhone的电池容量衰减,延长使用寿命。

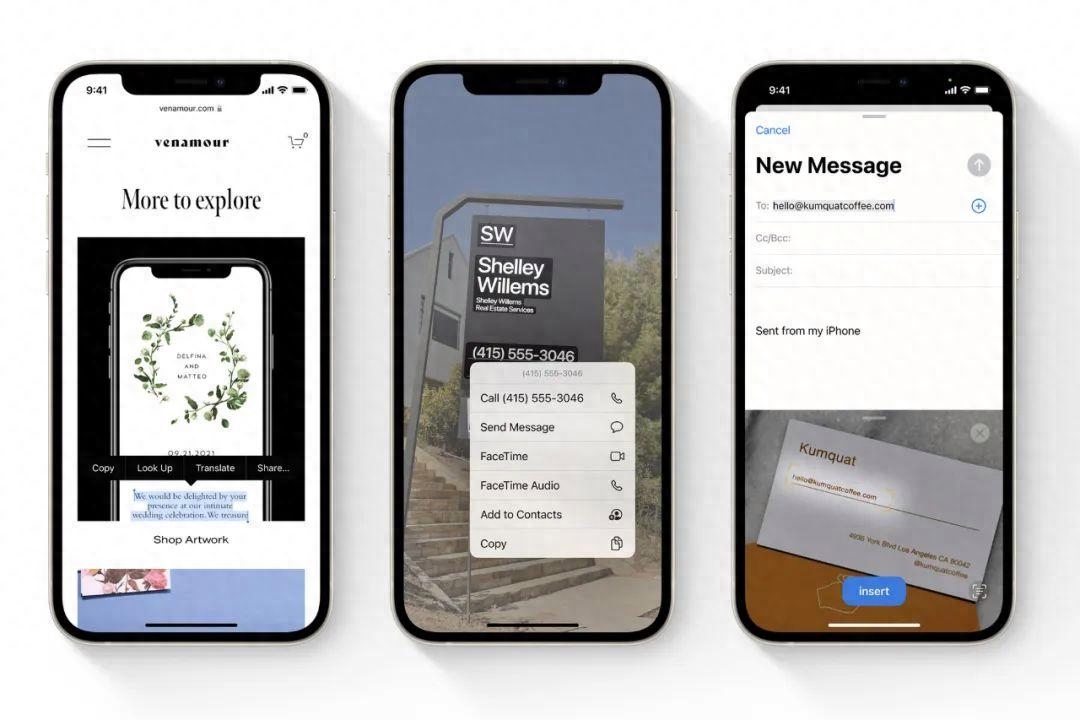

此外,苹果在去年的WWDC为iOS系统加入了相机识物与识字(OCR)能力,用户通过开启相机取景框,就可以快捷识别读取任意图片里边的文字、识别文稿并生成PDF、识别你的宠物和你的自拍照,然后将所有照片归纳在一个文件夹中等新功能,都基于苹果公司对于神经网络的长期研究与训练。而这一切,都不需要用户下载第三方APP即可实现。

另外一个例子是苹果今年WWDC上公布对于智能主动降噪耳机AirPods Pro的一项重要改进,即“当耳机检测到用户与外界他人对话时,将自动关闭降噪功能”,以便于用户可以聆听他人。苹果没有把它作为一个机器学习的结果来介绍,但这实际上是很难解决的技术问题,最核心的解决方案还是要通过大量的AI模型参与训练。

在今年的WWDC上,苹果公司只字未提AI大模型和如何训练,而是简单地提到了“这些功能背后有着很酷的技术支持”。在EVA看来,作为一家优秀的消费电子企业,苹果的面向核心受众是广大消费者,浅显易懂的应用场景使用方式介绍更符合落地营销的考量,而不是将口舌精力花在介绍自己的大模型如何“先进”。

谈到这,想起两天前发生的小插曲,特斯拉CEO埃隆·马斯克在个人推特上讽刺当前人工智能产业的现状,指出机器学习的本质就是统计学。他给图片配文是:“嘿,人工智能,你为什么总是戴着面罩?”暗讽令人啧啧称奇的AI大模型其实披着数据统计的外衣。这则插曲恰巧佐证了苹果希望规避舆情风险的小心谨慎。

因此,我们可能需要好好捯饬一下自己的大脑,究竟是否被ChatGPT呈现的表面概念所“绑架”了?如果真是如此,恐怕距离“AI危机”真的不远了。曾经有人提出这么一个观点:你如何确定你的认知不是ChatGPT给你灌输的?

身未动心已远,苹果的发力才刚刚开始

苹果公司对于人工智能的理解,或许有着自己独立的思考。值得一提的是,与其他竞争对手普遍采取云计算的解决方案不同的是,苹果公司看起来更希望在iPhone/iPad/Mac等终端上建立起AI本地运算模型。其优势在于采集更少的数据进行高效运算,而不是建立大型的服务器集群、超级计算机系统和TB级的数据中心,再匹配上百公里的光纤。

这一切,也是基于产品给用户实际体验的考量,试想一下,要是你在手机上运行一个大模型应用,然后响应速度慢得就像今天的ChatGPT生成文本,该是多么痛苦的一件事。而且这样做的好处是,AI运行在终端设备上,可以将核心数据保存在本地的芯片,绕过了许多基于云计算的AI工具面临的数据隐私上网和出海的监管问题,如此一来也更容易让苹果的产品准入各国的消费市场,满足当地的法律法规要求。

芯片的算力是AI训练里边永远绕不开的话题。用过的朋友都知道,今天热门的AI绘图工具Stable Diffusion和MidJourney都需要高贵的PC级图形显卡参与计算,那么苹果有能力在本地终端上建立起大模型的AI计算能力吗?

此问题的解,正是苹果在今年WWDC上发布的M2芯片家族最新成员——M2 Ultra。它采用台积电第二代5纳米工艺制程,拥有多达24个CPU内核、76个GPU内核和32个内核的神经引擎,每秒可进行31.6万亿次浮点运算。苹果表示,这种能力可能会在“训练大型Transformer模型时派上用场”。你瞧瞧,苹果嘴上从不提AI,身体还是很诚实的。

此外,M2 Ultra可以支持高达192GB的海量内存,这使其能够完成其他同类型的芯片组无法承担的任务。在一个单一系统中,M2 Ultra设备可以承受更庞大的机器学习工作负载,比如训练大型的Transformer模型,这类模型即使是目前最强大的PC装配离散GPU也无法处理,因为其内存带宽不足。

看完发布会,苹果公司前高管、知名计算机安全信息专家佩里·梅兹格就在其推特上表示:“苹果统一的内存架构意味着高端Mac现在真的成为运行大型AI模型和进行AI研究的惊人机器。在这个价位上,确实没有多少其他系统能提供192GB GPU可供访问的内存。”

更大的内存意味着能将更大的AI模型装进内存里,这将帮助更多的开发者有机会在个人电脑上训练AI。尽管目前尚未有M2 Ultra与英伟达的A100/H100显卡对比的测试,但至少从苹果官方的口径来看,在硬件算力能力的准备上,已经具备相当实力进入生成式AI训练的下一阶段。

除了硬件算力准备外,苹果公司也正在为AIGC时代的加速招兵买马,招募大量的AI专家。就在WWDC召开之前,5月份苹果在其官网新增挂出了28个工作岗位,从岗位需求来看,基本围绕AI展开,涉及高级工程师、研究科学家、特殊项目经理等等。据外媒透露,苹果在招募新晋软件工程师时,甚至要求对方在生成式AI和VR/AR混合现实两个领域都有建树。暗示会借助AIGC的力量,为其跨时代的MR头显设备创建更佳的APP体验。

据不完全统计,目前苹果公司在其招聘页面挂出的职位当中,有87个带有“人工智能”关键词,其中1/3是5月份新增岗位,另外有超过1/2是3月份后新设,显示了库克对于ChatGPT带来的AI产业变革的快速响应与雄心勃勃。

对AI“缄默”的AAPL太贵了吗?“股神”已经加仓

伴随全球经济下行,需求下滑带来了一系列危机,去年半导体产业空前暴跌,苹果公司的手机销量也深受负面影响,今年已经向富士康提请减产申请。而ChatGPT的现象级爆火,率领英伟达为首的“AI概念股”一飞冲天,对于AAPL这种存在产业滞后性的消费级企业,后续也会带来正向的联动影响么?EVA不敢说Yes。

但今年第一季度巴菲特继续加仓苹果,其名下的伯克希尔·哈撒韦公司公布了持仓报告。前十大重仓股里边,AAPL排名第一。苹果公司依然是巴菲特的心头好,一季度对苹果的持仓股数增加2%,持仓总额来到了1509.76亿美元,占公司持仓比例的46.44%。巴菲特可谓是对AAPL情有独钟,也展示了老头对于苹果业务边界与消费潜能的无限憧憬。

近期文章

更多