2024-09-05 16:59

2024-09-05 16:59

全球最大,马斯克4个月建成10万张H100超算集群!xAI算力超越OpenAI,奥特曼怕了

马斯克的xAI一路狂飙突进,把Sam Altman都整怕了!

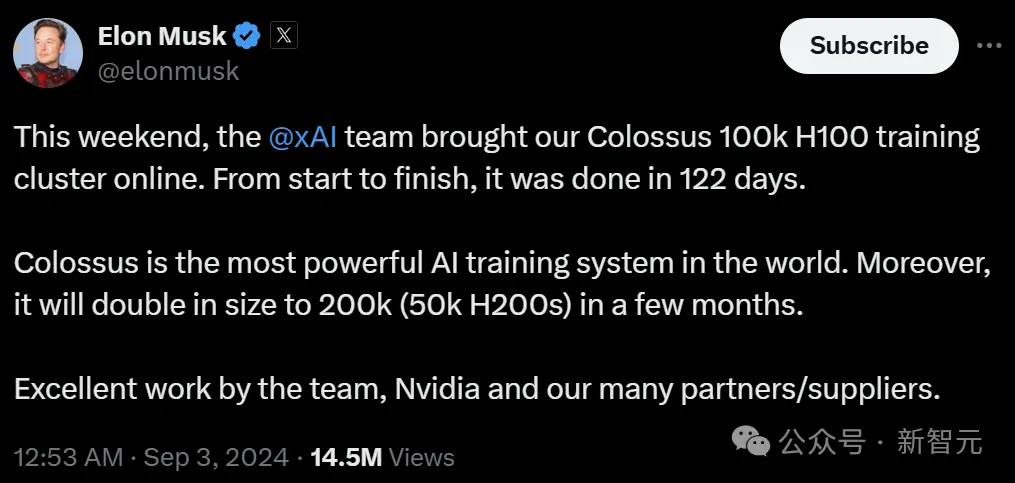

就在9月3日,马斯克在推上得意自曝:

团队仅仅用了122天时间,就建成了有10万张H100的Colossus集群,是世界上最强大的AI训练系统。

而且,未来几个月规模还要翻一倍,扩展到15万张H100+5万张H200.

最后,马斯克感谢了英伟达和许多其他合作伙伴、供应商。据悉,是戴尔开发、组装了Colossus系统。

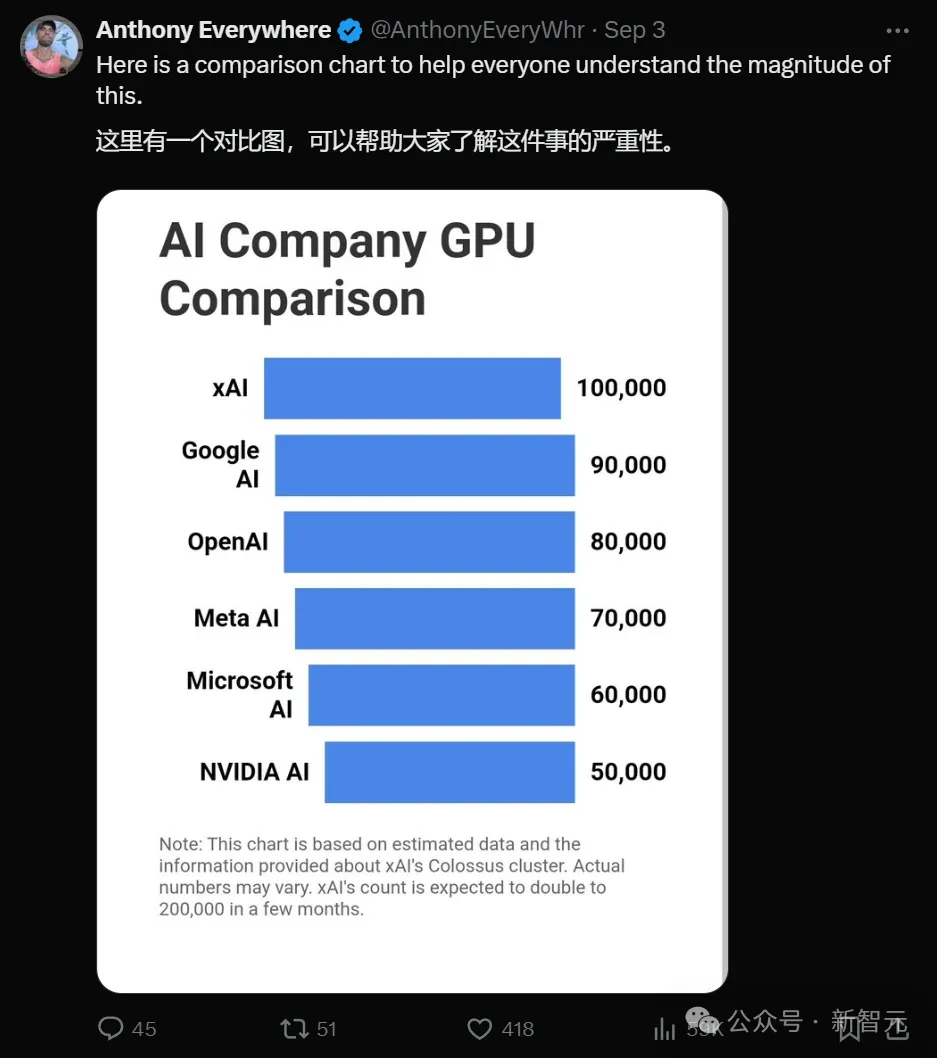

马斯克的xAI,已经让几大AI巨头感受到了强烈的威胁。

根据内幕消息,Sam Altman就曾表示,自己是怕了马斯克了!

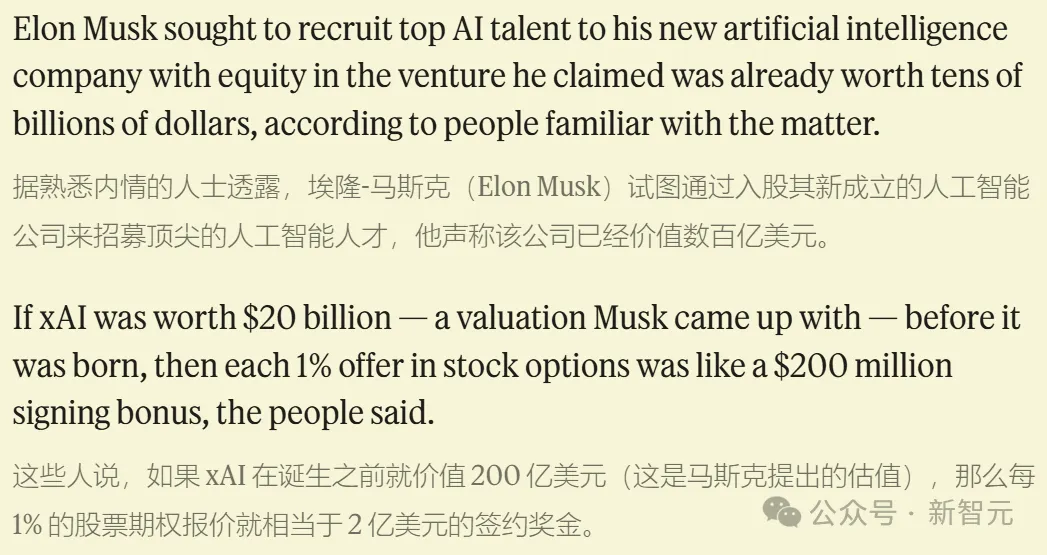

如今的xAI,不光算力有超越OpenAI之势,还对员工十分大方。有说法指出,对于xAI的研究者,马老板曾承诺过价值2亿美元的期权。

马斯克,全力进军超算

相信大家都已经发现:马斯克的超算野心,是愈发藏不住了!

隔三岔五的,就会有劲爆消息曝出。

7月底,xAI启动了位于孟菲斯的超级AI集群的训练,该集群由十万个液冷H100 GPU组成。

十万个H100 GPU消耗的电力大约在70兆瓦,因此这个超算至少会消耗150兆瓦的电力。

8月底,特斯拉宣布了Cortex AI集群,包括5万个英伟达H100 GPU,和2万个特斯拉的Dojo AI晶圆级芯片。

如今看来,这些集群很可能都正式投入运行,甚至已经在训练AI模型了。

不过,马斯克真的有能力让它们全部在线吗?

首要问题是,要调试和优化这些集群的设置,需要一定时间。

其次,xAI还得确保它们获得足够的电力。

我们知道,虽然马斯克的公司一直在用14台独立发电机为其供电,但要为十万块H100 GPU供电,这些电力显然不够。

训练xAI的Grok 2.需要两万块H100;而马斯克预测,要训练Grok 3.可能会需要十万块H100.

所以,xAI的数据中心,建得怎么庞大都不过分。

建设速度太快,推测是「部分上线」

122天,也就是4个月的时间,建成10万张H100组成的超算集群,这是个什么速度?

有业内人士表示,通常完成这样一个集群可能需要一年时间。

这个速度,这个规模,很马斯克。

但也有人猜测,他可能有夸大其词的倾向,高估了在单一集群中实际运行的GPU数量。

囤足10万张芯片、放在一起共同运行,并不意味着就是单一集群。

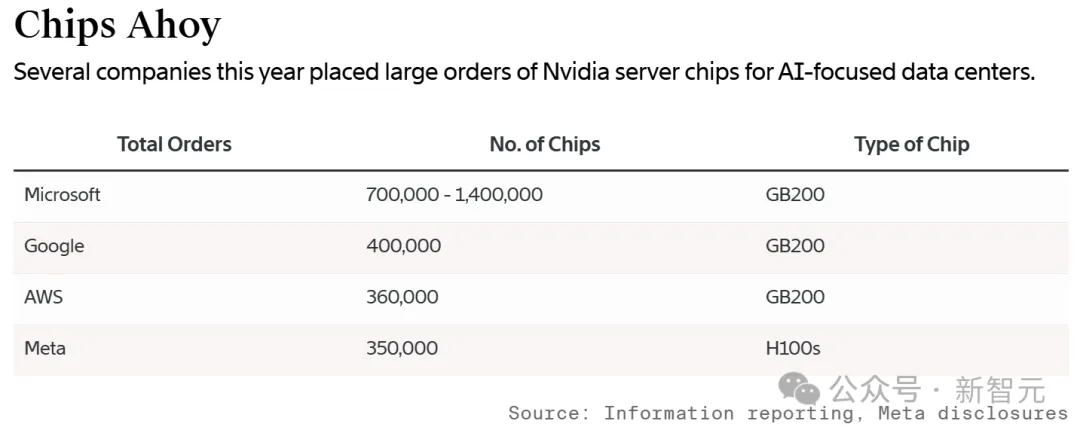

论GPU数量,Meta在今年1月就已经计划采购35万张H100.但实际运行时是分成了不同集群。

之所以还没有其他公司能造出10万GPU规模的集群,很难说是因为缺钱,更重要的因素是网络解决方案。

串联起所有GPU的网络,需要保证足够的高带宽、低延迟和可靠性,才能让10万张芯片协同起来像一台计算机一样工作。

Colossus是二战期间第一台可编程计算机,也曾在科幻电影里登场

除了网络,还有电力问题。

马斯克此前表示,Colossus在6月底已经启动运行,当时,电力公司供应的最高功率只有几兆瓦,仅能供应数千个GPU同时运行。

电力公司表示,到8月,xAI将获得大约50兆瓦的电力,但这只能供应大约5万个芯片。

与此同时,现场即将建成的另一个发电站将提供另外150兆瓦,可以满足10万个或更多芯片的电力需求,但要到明年才能实现。

马斯克似乎找到了一个短期解决方案:引入化石能源发电机。

Colossus所在地,田纳西州孟菲斯的环保组织前几天刚刚写信控诉马斯克,指责他在没有许可的情况下安装了至少18台涡轮机(可能更多),加剧了当地的空气污染。

出于网络和电力两方面的限制因素,The Information指出,马斯克的这个集群可能只是「部分完成」

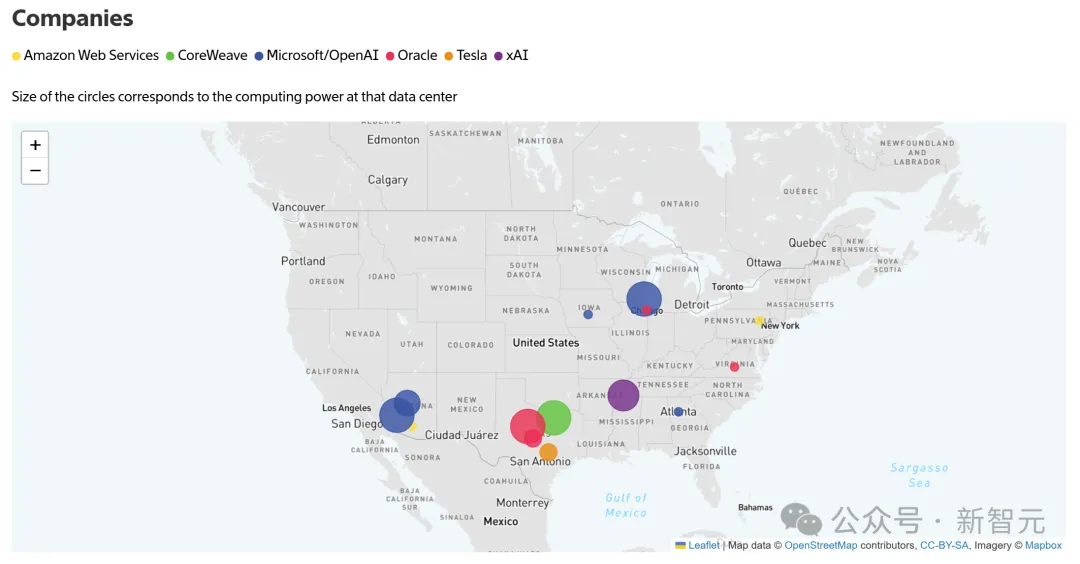

除了Colossus和微软在凤凰城为OpenAI建造的超算集群,多个类似的集群也正处在研发和建设过程中。

奥特曼:微软爸爸,我们的算力不够了

尽管如此,马斯克这个超大集群的进展,还是让一些竞争对手极度担心!

其中一位,就是OpenAI的CEO Sam Altman。

根据内部消息,奥特曼已经向一些微软高管透露了自己的担忧——

他十分担心,xAI很快就拥有比OpenAI更多的算力!

虽然为OpenAI提供算力的微软老大哥,资金实力非常雄厚,但作为上市公司,微软在花费资金时,还需要对公众股东负责。

但马斯克则完全没有这样的限制,尽管他的资金不如微软。

甭管马斯克有多少吹牛的成分,即使能部分完成Colossus集群的建成,也是一件令人印象深刻的事。

外媒The Information猜测,马斯克这种神奇的赶工速度,是否放弃了传统的例行安全检查?

毕竟,如果按例检查的话,可能会让数据中心项目的竣工延迟数月。

而且,The Information还发现了一个「华点」:Colossus位于以前的制造工厂内,这可不是适合高性能计算的理想场所。

微软和英伟达的高管透露,这是他们最不愿意放置昂贵硬件的地点之一。

因为这些地方很难改造,来适应服务器耗费的巨大电量,和数据中心设备需要的冷却技术。

咱们都知道,马老板一向喜欢突破边界,而在质疑声纷至沓来时,他又经常被证明是正确的。

最近在xAI的姊妹公司X,马斯克又有了一个惊人之举:关闭了一个数据中心。

当时大家都担心,X会因此而崩溃。结果谁也没想到,X运行得很好,马斯克居然有如此先见之明。

而这次,马斯克在田纳西州的超算,也同样可能会对AI开发者振聋发聩——

或许他们会发现,传统的做事方式如今已经过时了。

两家神秘AI巨头,正计划打造1250亿美元超算

如今,数据中心之战,竞争还在火热加剧!至少有六大巨头,已经下场了。

根据北达科他州官员的披露,除了微软、OpenAI和xAI,还有两家AI巨头也正在酝酿建造「巨型AI数据中心」。

这两家公司找到了商务专员Josh Teigen和州长Doug Burgum,商讨建立巨型AI数据中心。

除了技术研发,这类数据中心也对资源和基础设施提出了很高的要求。

不仅需要采购足够的芯片和相关设备,还要留出数万英亩的土地、建设新的发电设施。

马斯克的Colossus要自建发电站才能弄出200兆瓦,而这两家公司可能是因为直接找上了州长,他们的初始电力就能达到500~1000兆瓦,并计划在几年内扩增至5k~1w兆瓦。

这些项目的规模将比现有的任何数据中心,包括Colossus都扩大几个数量级。

100兆瓦可以为7万至10万个家庭供电;去年微软Azure的全球数据中心总共使用了大约5吉瓦(5k兆瓦)的电力。

这就意味着,一个数据中心,可能和整个Azure云服务平台的耗电量相当。

根据会议的音频记录,这类规模的项目耗资可能超过1250亿美元。

在对外会议上,商务专员Teigen没有透露这两家神秘AI巨头的名字,但他表示市值达到了「一万亿美元」。

这就将潜在名单缩小到了美国的大约6家公司,七巨头之六——英伟达、亚马逊、微软、谷歌、Meta和苹果。

微软此前就和OpenAI讨论过建造价值1000亿美元的「星际之门」(Stargate),而且北达科他州长Doug Burgum曾是微软的高管,在2001年以11亿美元向微软出售过自己的一家软件公司。

但我们也知道,谷歌和亚马逊等其他公司也在积极提升其AI计算能力。

揭开美国AI超算的神秘面纱

AI巨头一向对尖端技术严格保密,但他们对开发数据中心所需的技术,保密程度有过之而无不及。

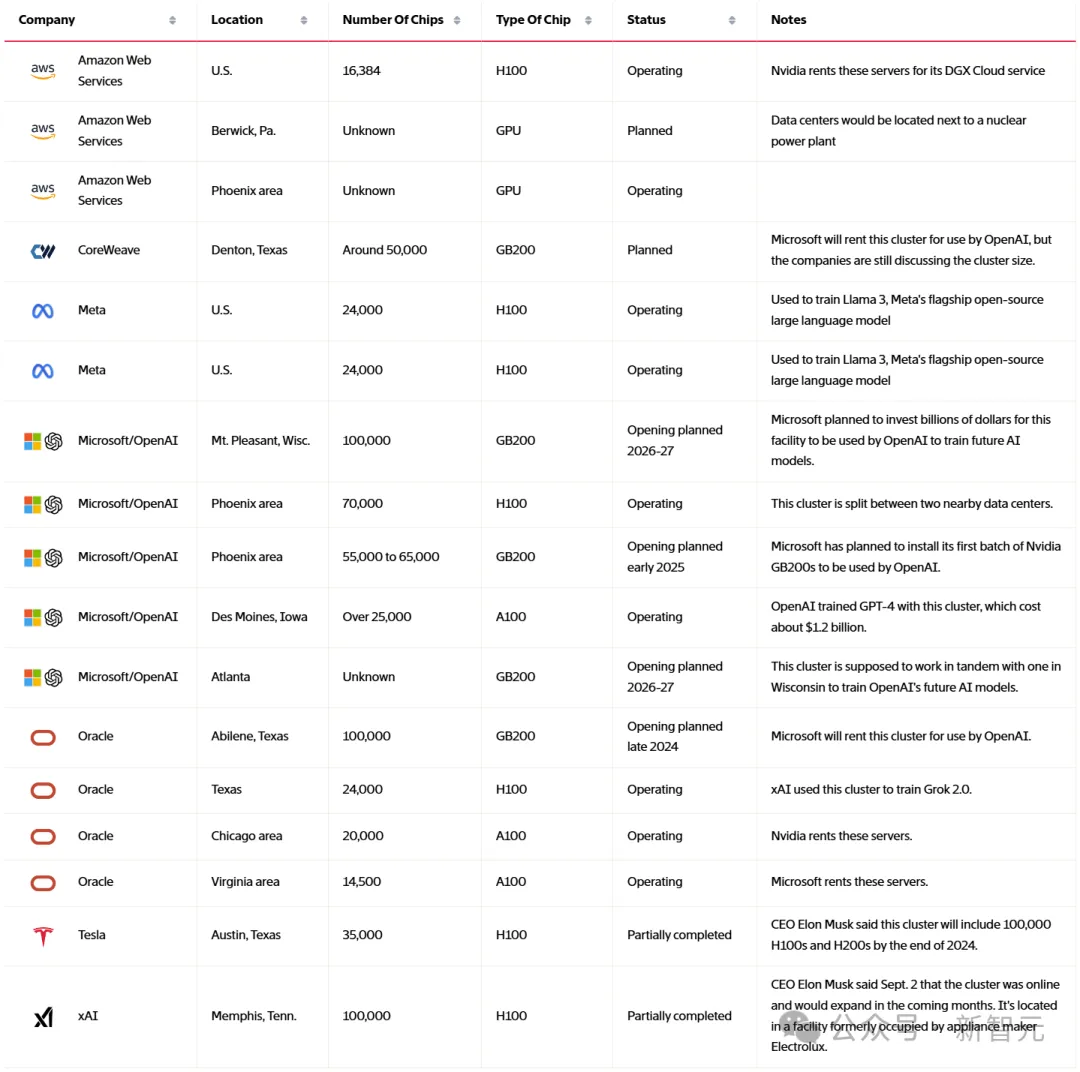

The Information列出了在美国7个州运营或计划中的17个超算数据中心,涉及微软、OpenAI、Meta和xAI等公司。

总的来说,仍在开发或计划阶段的设施建设成本可能超过500亿美元,其中包括约350亿美元的英伟达芯片,以及运营所需的额外数十亿美元。

这些超算估计在数年时间内落成,并需要大量的芯片、土地和电力。

在ChatGPT问世前,GPU集群通常只包含几千个芯片。如今,一些最大的GPU集群拥有超过3万个芯片,上面提到的这些超算更是达到了前所未有的规模。

要为所有计划中的数据中心供电,美国能源部预计会出现电力不足的情况,因此最近提出了一些解决方案,例如资助研究使AI计算更高效。

争夺「下一个高地」

现在,数据中心竞赛的焦点,集中到了英伟达CEO黄仁勋的身上。

就在上周,老黄发表了以下言论,宛如在业内投入一颗炸弹。

率先达到超算集群下一个高地的人,将实现革命性的AI水平。

此言一出,英伟达的GPU,谁敢不买?

即使已经和博通共同设计出了TPU的谷歌,最近也为英伟达即将推出的Blackwell下了大单。

对GPU的争夺,已经引发了AI开发者及其云供应商之间的紧张局势,甚至,有时还会引发它们和英伟达的摩擦。

比如,马斯克就曾考虑和甲骨文达成一项大规模协议,根据他的计划,xAI将在未来几年内,花费超过100亿美元租赁英伟达的GPU。

而这项谈判最终破裂了,部分原因在于,马斯克认为甲骨文无法足够快地建起超算,而甲骨文则担心,他会把GPU集群放在一个供电不足的地方。

芯片多多,问题多多

很多超大的GPU集群都位于土地辽阔、空间充裕且电力充足的地区。例如,马斯克的Colossus特意选址在田纳西州孟菲斯,亚马逊、Meta和微软都在亚利桑那州的凤凰城地区运营AI服务器。

但随着更大的GPU集群需要更多的电力,AI巨头们正计划在非传统数据中心枢纽的地区建造这些集群。

例如,亚马逊最近在宾夕法尼亚州中部的一座核电站旁边购置了土地,计划供应约一吉瓦(1000兆瓦)的电力。

这足以为整个旧金山供电,或者构建多达100万张GPU的集群。

另一个挑战是如何进行设备冷却。

传统上,数据中心一般采用风冷,但GPU服务器产生的热量远远超过传统服务器。

为了更佳的冷却效果,微软在威斯康星州为OpenAI建设的数据中心预计将使用液冷而非风冷。

虽然如今越来越多人怀疑,AI泡沫要接近临界点了,但兴建超算之风,一时半会还不会冷却。

毕竟,竞家都All In了,你能不上吗?

六巨头割据,群雄逐鹿,谁将夺得下一个超算高地?

近期文章

更多